友情提示

本站部分转载文章,皆来自互联网,仅供参考及分享,并不用于任何商业用途;版权归原作者所有,如涉及作品内容、版权和其他问题,请与本网联系,我们将在第一时间删除内容!

联系邮箱:1042463605@qq.com

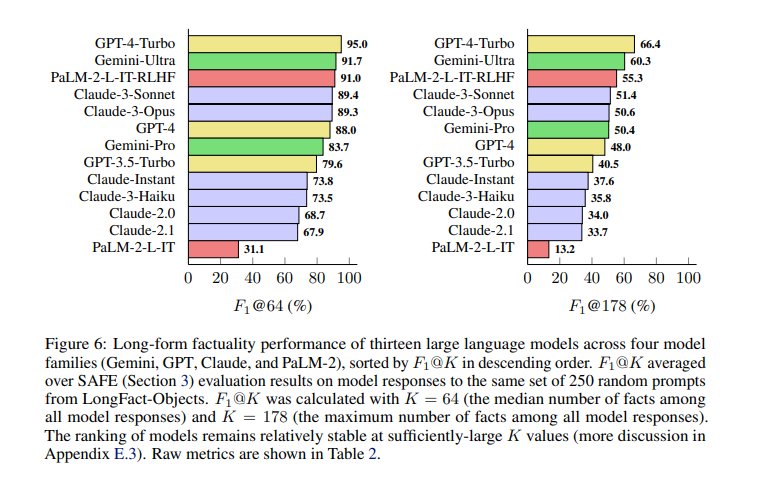

谷歌Deepmind、斯坦福大学研究人员推出AI事实核查工具

35

0

相关文章

近七日浏览最多

最新文章

标签云

安卓

谷歌

华为手机

iphone

三折叠屏手机

腾讯

微信

ios

苹果公司

apple

俄罗斯

youtube

微软

英伟达

美国司法部

美元

chro

ibm

李开复

融资

linux

android

pi

搜索引擎

美国联邦

快科技

美国

a股

etf

马斯克

abb

alphabet

奥尔特

美股

期货

股票回购

100指数

美国政府

路透社

美国法院

jonathan

初创公司

john

gpu

芯片

siri

苹果

联邦法院

美政府

cpi

许家印

twitter

cma

特斯拉

刘强东

巴菲特

ipad

人工智能

奥运

亚马逊

英国

科技

香港

学霸

斯坦福

联合国

斯坦福大学

奥运会

世乒赛

乒乓球

美国队

美国历史

乒乓球队

中国人民大学

花样滑冰

跆拳道

中国队

夺冠

研究院

肺部

健康

病变

德克萨斯

美国大学

密歇根大学

计算机科学

github

alex

操作系统

adobe

亚瑟

中国政府

经济学人

半导体

中国

turbo

郭沫若

公务员

科创板日报

机器人

上海证券

中科大

学生时代

英格拉姆

哈里森

国际篮联

nba

北卡罗来纳大学

高校

贝索斯

前妻

新京报

录用

考试

博士

县乡镇

中国文化

刘雪华

马克

中国传统文化

chris

清华大学

刘知远

清华

科学家

电动汽车

国家安全

兵马俑

霍夫曼

基本每股收益

股价

孙悟空

宝马集团

大族激光

工业机器人

国产品牌

navi

股票

减持

黄仁勋

cpu

巴黎

吉利

北航

昆虫

nlp

天眼查

五老星

卡普

路飞

海贼王

草帽海贼团

贝斯特

36氪

运动能力

预告片

nfc

oled

中学

高通

伯克希尔哈撒韦